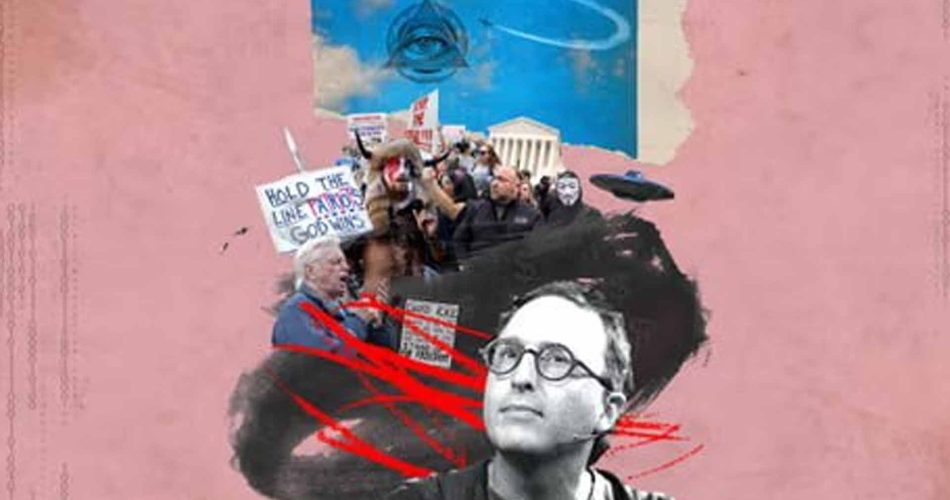

تا به حال با کسی که به تئوریهای توطئه مضحک باور دارد صحبت کردهاید؟ نظریاتی مثل این که «زمین تخت است» یا «انسانها هرگز روی ماه فرود نیامدهاند» یا «در واکسنهای کرونا میکروچیب ردیاب کار گذاشته بودند» و …؟

به گفته gizmodo یک پژوهش گسترده با عنوان «روشن گری برای معتقدان به تئوریهای توطئه از طریق گفتگو با هوش مصنوعی» ثابت کرده که اگر این انسانها با ربات های هوش مصنوعی به گفتگو بشینند، احتمالا قانع شوند که اشتباه میکنند!

این مطالعه شامل دو آزمایش با ۲,۱۹۰ شرکت کننده آمریکایی بود که به یک تئوری توطئه خاص باور داشتند.

از شرکتکنندگان خواسته شد شواهدی که به نظرشان از این تئوری خاص حمایت میکند را توضیح دهند و سپس با هوش مصنوعی GPT-4 Turbo وارد گفتگو شدند. ربات سعی کرد با ارائه شواهد آنها را قانع کند که اشتباه میکنند. نتیجه بسیار دلگرم کننده بود:

هوش مصنوعی توانایی خیلی خوبی در ارائه استدلال و برقراری گفتگوهای شخصی و عمیق با این افراد داشت و توانست پس از چند ماه این باورها را تغییر دهد!

شاید فکر کنید بحث با این افراد بیاهمیت است اما یک تئوری توطئه میتواند بالقوه برای جامعه خطرناک و آسیبزا باشد. اطلاعات نادرست همیشه برای جامعه آسیب زاست و این باورها اعتماد عمومی به نهادها را کاهش داده و باعث دوقطبی شدن و افزایش تنشهای اجتماعی میشوند. اما احتمالا هوش مصنوعی واقعا میتواند چنین اثر و منفتی برای بشریت داشته باشد و این افراد با باورهای عجیبشان را قانع کند!