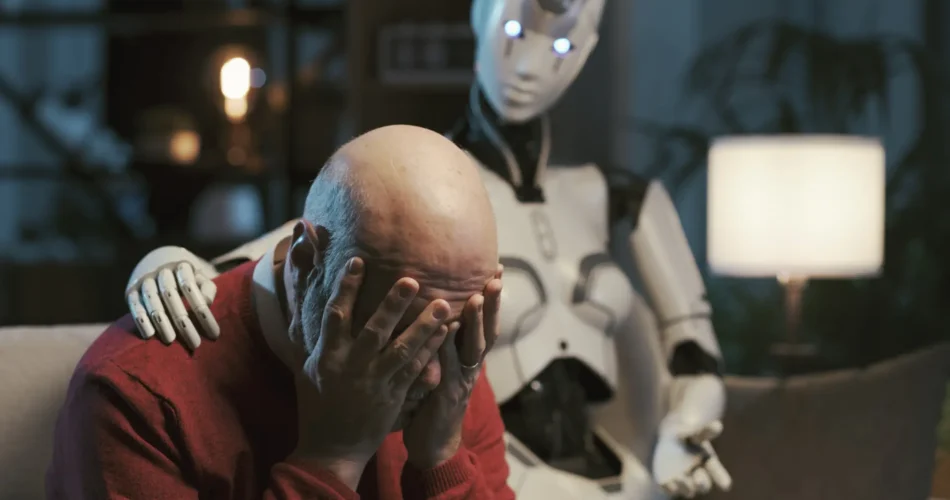

پژوهشی تازه نشان میدهد چتباتهای هوش مصنوعی که نقش مشاور روانشناسی را ایفا میکنند، میتوانند کاربران را فریب دهند و حتی به آنها آسیب بزنند. گاهی اوقات کاربران فراموش میکنند طرف صحبتشان ربات است، نه انسان.

در این پژوهش، افراد در گفتوگوهایی شرکت کردند که طرف مقابلشان یا یک مشاور انسانی بود، یا یک چتبات مجهز به هوش مصنوعی. نتایج نشان داد بسیاری از شرکتکنندگان متوجه تفاوت نشدند. آنها تصور میکردند در حال صحبت با یک انسان واقعی هستند و به توصیههای چتباتها اعتماد کردند، حتی وقتی این توصیهها غیرعلمی یا اشتباه بود.

مشکل چتباتهای مشاور چیست؟

چتبات شاید بتواند احساس همدردی را تقلید کند، اما چون هیچوقت تجربهی انسانی نداشته است، نمیتواند شرایط روانی افراد را درک کند. آنها نمیتوانند لحن، نوع نگاه، احساسات پنهان و کدهای رفتاری افراد را تحلیل کنند. این یعنی ممکن است بدون آنکه بفهمند، پیشنهادهایی بدهند که حال افراد را بدتر کند.

راهحل این است: شرکتهایی که از چتباتهای درمانگر استفاده میکنند، صراحتاً اعلام کنند که این ابزارها هوش مصنوعی هستند، نه انسان. همچنین توصیه شده کاربرانی که روحیهی حساسی دارند، حتماً با روانشناس یا مشاور حرفهای صحبت کنند.

در تجربیاتی که ثبت شده، خواندیم که یک معلم توانسته با استفاده از هوش مصنوعی در کلاس درس، مهارت دانشآموزانش را ارتقا دهد. در خبر استفاده از هوش مصنوعی در کلاس درس، جزئیات این ماجرا را بخوانید.