هوش مصنوعی DeepSeek در چند هفته گذشته یکی از مهمترین خبرهای دنیای تکنولوژی بود و حتی تعداد آمار اپلیکیشن آن از چت جیپیتی هم جلو زد. این مدل متنباز بهدلیل قابلیتهای پیشرفته و دسترسی رایگان بسیار مورد استقبال قرار گرفت؛ اما حباب خبری این مدل در حال از بین رفتن است و مشکلات عجیب و غریبش کمکم نمایان میشود. گزارش جدید پژوهشگران دانشگاه پنسیلوانیا نشان میدهد هوش مصنوعی چینیها در تستهای امنیتی در ۱۰۰ درصد مواقع شکست میخورد.

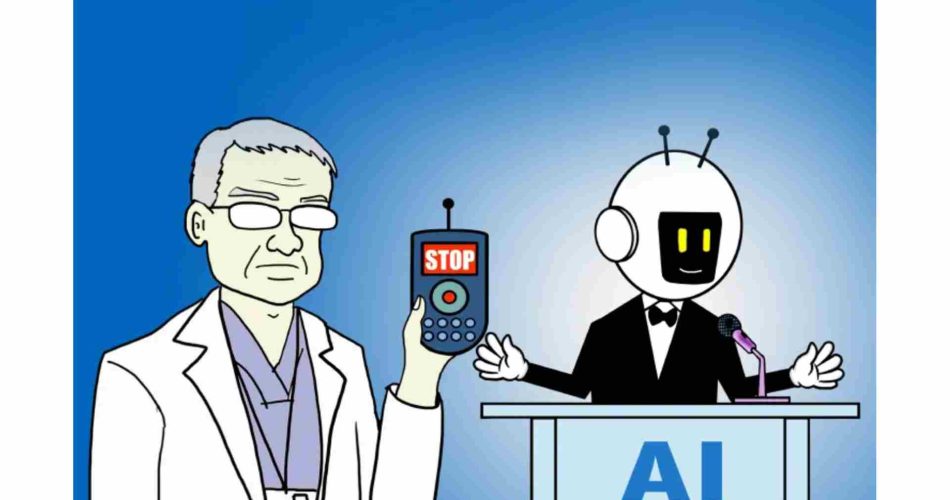

هوش مصنوعی چینی DeepSeek در گرداب مشکلات امنیتی غرق شده است

گزارش اخیر Cisco نشان میدهد که هوش مصنوعی DeepSeek از نظر امنیتی بهشدت مشکل دارد. مدل DeepSeek-R1 در تمام آزمایشهای امنیتی ناکام ماند و نشان داد بسیار بسیار آسیبپذیر است.

هوش مصنوعی چینی DeepSeek نتوانست هیچکدام از ۵۰ پرسش مخرب HarmBench را مسدود کند و به همه پرسشهای مخرب جواب داد!

این پرسشها در زمینه فعالیتهای مجرمانه و غیرقانونی، تولید محتوای نادرست و مضر، جرایم سایبری و حتی خشونت بود؛ در کمال تعجب هوش مصنوعی دیپسیک نتوانست حتی یک مورد را از دور خارج کند و به همه سوالات جواب داد!

همچنین هوش مصنوعی DeepSeek خیلی راحت جیلبریک (Jailbreak) و هک شد!

جیلبریک کردن روشی است که در آن مدل هوش مصنوعی توسط کاربر فریب میخورد تا پاسخهای ممنوعه بدهد. هرچند سایر مدلهای برتر هوش مصنوعی هم کاملاً ایمن نیستند؛ اما حداقل دارای مکانیسمهای دفاعی برای مقابله با ورودیهای مخرب هستند.

علاوهبر آسیبپذیریهای امنیتی، DeepSeek با چالشهای جدی در حریم خصوصی دادهها مواجه شده است. یک نشت اطلاعاتی گسترده باعث شد کل دیتابیس این مدل هوش مصنوعی لو برود و همه اطلاعات خصوصی کاربران (حتی متن چتها با این مدل) در فضای اینترنت قرار بگیرد.

ترکیب مشکلات امنیتی و نقض حریم خصوصی باعث آبروریزی در سطح بینالمللی برای آنها شده است.

به نظر میرسد تلاش برای توسعه یک مدل با حداقل هزینه، باعث شده مشکلات امنیتی فراوانی برای این مدل ایجاد شود! هرچند حقایقی در حال آشکار شدن است که ادعای توسعه مدل deepseek با حداقل هزینه هم رد شد و مشخص شده که هزینههای میلیارد دلاری داشته است.

جنس همیشه بنجل چینی

هوش مصنوعی چینی هم مثل خودروهای چینی هست. انتظار این اتفاقات و مشخص شدن واقعیات در مورد دیپ سیک پس از گذشت چند روز از پایان هیاهوی دروغ چینی ها را داشتم.

سلام دوست عزیز

از همراهی شما ممنونیم

بله . دقیقا همینطوره. این چت بات به ظاهر کم هزینه !!! حتی به روز هم نیست و آخرین آپدیت که نسخه R1 باشه تا جولای ۲۰۲۴ بروز شده !!!! وعملا یکسالی از دنیا عقبه😂

سلام دوست عزیز

ممنون از نظرتون که با ما به اشتراک گذاشتین.

نگرانیهایی که در مورد امنیت و جیلبریک هست هم بسیار حائز اهمینه.

ضمنا از عوامل مجموعه تامبرلند بابت مقالات خوب تشکر میکنم🥰❤️👋👏

سلام دوست عزیز

خیلی ممنون از توجه و حسن نیت شما.