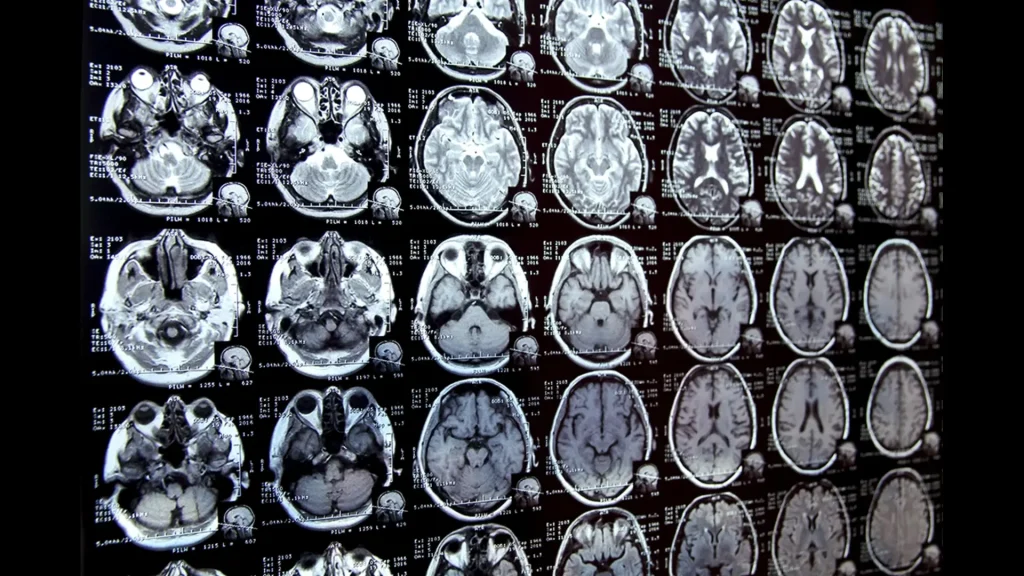

آیا شده شما هم نتیجه آزمایشات پزشکی یا تصویربرداریهای رادیولوژی خود را به هوش مصنوعی بدهید تا برایتان تفسیر کند؟ اینکاری است که بیشتر مردم انجام میدهند، اما ادامه مطلب را بخوانید تا بفهمید چرا اینکار اشتباه است و نباید دیگر انجام دهید!

هشدار مهم درباره استفاده از هوش مصنوعی

این روزها بیشتر مردم به چتباتهای هوش مصنوعی، مانند ChatGPT از OpenAI و Gemini از گوگل، مراجعه میکنند تا درباره نگرانیهای پزشکی خود بپرسند. برخی حتی از اپلیکیشنهای مشکوکی استفاده کردهاند که با کمک هوش مصنوعی تشخیص میدهند آیا اندامهای تناسلی فرد سالم هستند یا خیر!

اطلاعات پزشکی جزو دستهای خاص از دادهها هستند که فقط و فقط خود شخص شما اجازه افشای آن را دارید.

کارشناسان امنیت و حریم خصوصی مدتهاست هشدار دادهاند که هر داده حساسی که روی اینترنت آپلود شود ممکن است برای آموزش مدلهای هوش مصنوعی استفاده شود و در آینده اطلاعات شخصی و حساس شما را به خطر بیندازد.

مدلهای هوش مصنوعی مولد معمولاً با دادههایی که دریافت میکنند آموزش داده میشوند، با این فرض که دادههای آپلود شده به بهبود اطلاعات و دقت خروجی مدل کمک میکنند. اما به گفته techcrunch، مشخص نیست که این دادهها چگونه و برای چه اهدافی استفاده میشوند یا با چه کسانی به اشتراک گذاشته میشوند.

به خاطر داشته باشید که هر چیزی که وارد اینترنت شود، دیگر هرگز از اینترنت پاک نمیشود.

شاید اکنون مدیران شرکتهای هوش مصنوعی بگویند که «ما از دادههای شما فقط برای آموزش مدل هوش مصنوعی استفاده میکنیم و هیچ استفاده غیرمسئولانهای رخ نخواهد داد» اما معلوم نیست که آنها نظرشان را در آینده عوض نکنند؟! و اگر نظرشان عوض شد، چه اتفاقی برای دادههای شما خواهد افتاد؟! ما به تازگی دیدهایم که هوش مصنوعی نسبت به انسانها خشم و تنفر نشان داده!

همچنین در نهایت باید به احتمال تشخیص اشتباه و یا توصیه غلط توسط هوش مصنوعی اشاره کنیم! هوش مصنوعی دانشمند نیست و احتمال اینکه اشتباه کند بسیار زیاد است. بنابراین نباید به توصیههای هوش مصنوعی اعتماد کامل کنید و آن را انجام دهید.